继微软之后,谷歌也全面拥抱人工智能(AI)智能体(Agent)。在开发者大会上,谷歌宣布要让智能体全面进驻谷歌的主打业务搜索以及AI助手Gemini,并通过Gemini与搜索结合,推出全新的AI模式搜索。

当地时间5月20日,谷歌2025年度I/O开发者大会的主题演讲展示了在AI、多模态模型、跨设备整合与开发者工具方面的最新成果。从升级后的Gemini 2.5 Pro模型到智能眼镜的XR应用,再到AI驱动的搜索与网页浏览体验。谷歌展现的不仅是模型的性能提升,更是AI从“信息工具”进化为“通用智能体”的进步。

本次发布内容主要包括:

模型:Gemini 2.5 Pro/Flash/DeepThink;Diffusion;Imagine 4;Lyria;

应用:Gemini App、Canvas、Chrome助理、AI Mode、Agent模式;

搜索:AI Overview+Mode;支持个性化、多步推理、自动执行任务;

创作:Flow平台、文本转图像、图像转视频、原生音频合成|

硬件:Android XR头显、智能眼镜原型、WearOS、车载整合

谷歌最强通用AI模型Gemini 2.5 Pro

刚开场,登台的Alphabet兼谷歌CEO皮查伊(Sundar Pichai)就强调了Gemini的重要性,称“在谷歌,每天都是Gemini季”,并力推新模型Gemini 2.5 Pro——“迄今为止我们最强大的通用AI模型”。

皮查伊说,自上次I/O大会以来,谷歌已推出十多款模型和20项AI功能,谷歌的发布速度已经是史上最快:

“我们希望尽快将最好的模型和产品交到大家手中,因此我们的发布速度比以往任何时候都快。”

皮查伊透露,Gemini 2.5 Pro模型已在大语言模型(LLM)测评LLM Arena的所有类别排行榜上名列前茅。Gemini是热门AI代码编辑器Cursor上增长最快的模型。

他介绍,一年来,谷歌系统每月处理的token数量激增,从去年的9.7万亿增加到现在的480万亿,增长将近50倍。Gemini的App每月有4亿多活跃用户。

“智能体模式”将上线Chrome、搜索及Gemini App

皮查伊宣布,谷歌将在Chrome浏览器、搜索以及Gemini的App中推出智能体模式(Agent Mode)。

智能体可以与浏览器和其他软件进行交互和操作。谷歌研究的AI智能体Mariner现在可以同时管理多达10个任务,用户只需向其展示一次任务,它就会学习该任务,并将经验用于未来的案例。

智能体模式的实验版即将向Gemini App的订阅者推出。

皮查伊现场演示Gemini App中的智能体模式,要求它帮用户找公寓。得到指令后,Gemini搜索房产网Zillow,用电脑调整筛选条件,并使用模型上下文协议MCP预约看房。

皮查伊评价:

“这是一个新兴的时代。将研究成果转化为现实的最佳方式就是让它真正发挥作用。”

他说,在经用户许可的情况下,Gemini现在可以在各种App中以“私密安全”的方式使用个人信息。

在AI综述的基础上,谷歌在搜索引擎中正式推出由Gemini2.5模型驱动的AI模式。由于AI的特性,用户可以向搜索引擎提出更复杂、更难的问题。谷歌表示,现在用户从搜索引擎中得到的不只是信息,而是智慧。

未来谷歌还将AI模式与用户邮箱等个人信息打通,提供个性化的建议。与此同时,同类AI工具中常见的“深度研究”功能也将集成在这个模式中。

同时通过将先进多模态模型和实时对话等功能结合,谷歌也将在今年夏天推出实时影像搜索功能。用户可以开着摄像头向AI实时提问。

谷歌搜索添加AI模式标签页支持长达数百字提问

皮查伊称AI概览(AI Overviews)是谷歌最成功的产品之一,每月有15亿用户在搜索中使用AI概览,它推动某些类型的查询增长了10%。这意味着,谷歌提供生成式AI服务的用户规模超过其他公司。

Gemini模型将与谷歌搜索集合。它将通过AI模式(AI Mode)增强智能,成为一种强大的新型AI搜索功能,可帮助解答问题。它是搜索中的新标签页,也将包含在AI概览中。

作为全新的搜索功能,AI模式让用户可以提出更长、更复杂的查询。它支持长达数百字的提问、自动分解查询意图、并生成结构化答案。该模式当地时间5月20日就上线,作为搜索的新标签页形式,向所有美国的用户推出。

新版本中,用户可以:

直接通过自然语言发问,系统会提供摘要式、结构化回答。

与搜索结果进行多轮对话,进一步深入了解相关内容。

获取图文并茂的“智能回答卡片”,例如自动整理出旅游行程、购物建议、编程指南等。

皮查伊称:“我们正在重新定义搜索的未来。不是找到链接,而是直接给出答案。”

谷歌搜索负责人Liz Reid介绍,AI模式会得到名为Deep Research的模型加持,谷歌称之为“深度搜索”(DeepSearch)。该模型将通过逻辑搜索结果和高度相关的内容,更好地整理研究主题。

“就像你身边有一位博学助理。”它还会结合地图、评论、视频等生成图表和推荐内容。

Reid说,AI模式将拥有谷歌所有最优秀的AI特性和功能。“随着时间的推移,我们将逐步将AI模式的许多尖端特性和功能融入核心搜索体验。”她还说,AI模式现在就将支持AI概览。

谷歌光束、同声传译功能

谷歌光束(Google Beam):极具未来主义的视频会议设备,从不同角度捕捉用户影像,使用AI技术将这些视频流合并,并在3D光场显示器上呈现用户的3D形象,帧率最高可达每秒60帧。首批“谷歌光束”设备将于今年晚些时候通过合作伙伴惠普推出,具体定价尚不清楚。

同声传译:在谷歌会议软件Google Meet中,用户可以使用不同语言进行实时对话,同时保留原声的音色、语调和情感表达。目前已经向订阅用户开放英语和西班牙语之间的实时翻译,未来几周将陆续增加意大利语、德语和葡萄牙语等更多语言。

此外,AI模式下也将提供购物决策的全流程支持——从“买什么”到“去哪里买”一步到位。谷歌也在实验室中推出虚拟试穿衣服工具,用户可以上传一张自己的照片,直观感受购物车里的衣服“穿在”自己身上的样子。

这款工具旨在简化AI生成视频的创作流程。Flow与Veo 3视频生成模型,针对Veo 2模型的更多控制功能,以及图像生成模型Imagen 4一同亮相。

与此同时, Veo 3模型不仅生成质量更高、理解提示词更准确,还能同步生成视频和音频,包括不同角色的对话。此外,Veo 2将增加相机控制和对象移除等工具,Imagen 4在生成图片时也能准确生成真实文本,而不是一堆乱码。

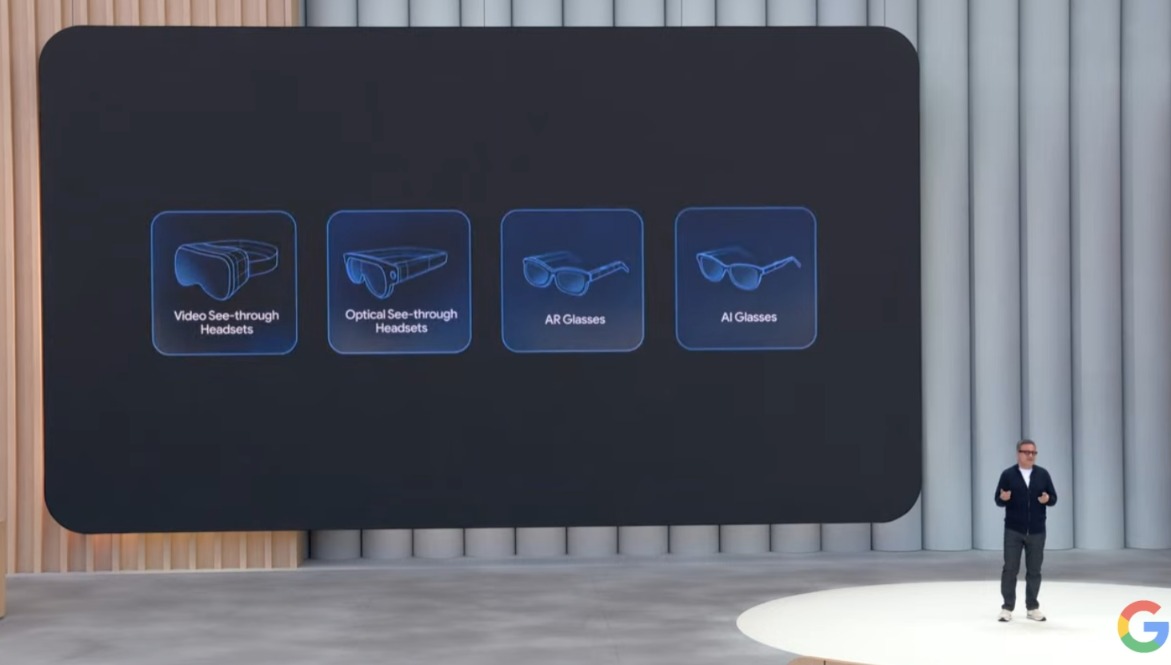

推出的安卓XR平台针对一系列AI眼镜设备

谷歌工程主管Shahram Izadi介绍称,除了手机外,未来几个月里谷歌将会把Gemini AI功能拓展至智能手表、汽车控制台、电视上,以及你的眼镜上。

Izadi介绍称,谷歌推出的安卓XR平台针对一系列AI眼镜设备,意味着每个人可能会购买不止一副AI眼镜。例如看电影或者工作时,你需要更具沉浸感的头戴式设备;而出行购物时,你会需要轻便的眼镜提供实时信息。

安卓XR是谷歌与三星、高通一起开发的平台,自从去年公布项目后,现在已经有数百家软件开发商为这个平台提供适配。三星的Project Moohan是第一款安卓XR设备,并将在今年晚些时候开放购买。

谷歌也宣布,与中国AR品牌Xreal达成战略合作,以Project Aura的名义推出第二款安卓XR设备,也是首款搭载安卓XR平台的AR眼镜。

还未登录

还未登录